Google未來將加入讓使用者透過哼唱方式 (Hum to Search),即可搜尋對應歌曲等內容的功能,或許未來也會協助使用者查找各類一閃而過的想法。

透過人工智慧比對、串接更多資訊

在稍早以線上形式舉辦的Google Search On活動中,目前負責帶領Google Search項目的Google副總裁Prabhakar Raghavan重申,Google Search服務建立在「了解世界上各類資訊」、「提供最佳解答內容」、「維持高度隱私安全」,以及「開放所有人輕易使用」四個面向。

聚集四個面向

Prabhakar Raghavan重申,Google Search服務建立在「了解世界上各類資訊」、「提供最佳解答內容」、「維持高度隱私安全」,以及「開放所有人輕易使用」四個面向。

為了了解僅透過搜尋框輸入的關鍵字詞背後所涵蓋意義,Google從早期藉由關際字詞比對、建立知識圖表 (Knowledge Graph),以及串接更多資訊等方式,到目前整合諸如人工智慧、影音內容、地圖資訊等資源,同時透過機器學習等方式判斷使用者是否打錯字,或是預測使用者實際可能預期搜尋內容,藉此加快整體搜尋反應速度,並且提供更正確內容。

而為了進一步了解使用者搜尋需求,Google不僅比對大量數據,更同時檢視錯誤內容,藉此深入了解使用者在使用搜尋功能時的真正想法。同時為了因應每天增加的搜尋量,以及平均高達15%比例的搜尋內容是從未見過情況,Google更藉由打造自有Cloud TPU運算模組,透過建構高達100Petaflops以上運算量,並且透過超過6.8億組條件分析,在更短時間內完成檢索,再將結果顯示在搜尋頁面。

不僅搜尋文字內容

除了透過圖像、文字內容呈現,Google更進一步結合圖表、地圖、影片、擴增實境等內容呈現搜尋結果,讓使用者能一眼了解答案內容,甚至也陸續加入更多語言內容,並且配合不同語言對應更貼切的搜尋服務,例如針對中文使用者的搜尋服務將會更貼近個人使用體驗,甚至會考量使用者所在位置提供更符合在地化的搜尋內容。

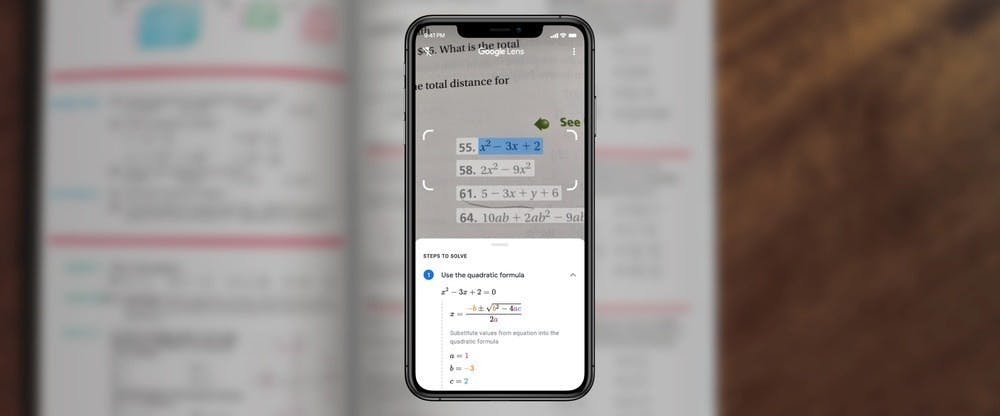

另外,Google Lens也成為目前Google重點發展項目,讓使用者能直接透過手機照相功能搜尋難以藉由關鍵字詞比對內容,例如街上的招牌、餐廳的菜單,甚至是路人身上所穿外套,Google希望讓使用者能藉由Google Lens服務,透過手機拍照進行搜尋,並且透過圖像識別、翻譯等功能,讓使用者能更快了解招牌或菜單上的字詞意思,或是找出路人身上外套可在哪裡購買,以及如何穿搭。

不僅針對使用者所輸入關鍵字詞進行狹義精準搜尋,Google也會依照情況判斷提供更廣義的搜尋結果,尤其是有不少相近詞彙對應搜尋結果,或是系統認為使用者搜尋內容較為廣義的話,搜尋結果就會查找更多相符結果,讓使用者更容易自行選取合適解答內容觀看。

不同搜尋方式

Google Assistant數位助理服務,實際上也是基於Google Search搜尋服務打造,讓使用者能透過口語互動方式,透過人工智慧方式找到問題最佳解答,甚至能由Duplex功能,由人工智慧協助完成電話撥打預約服務、或是協助接聽不想回應電話,甚至加入更自然的擬針對畫功能。

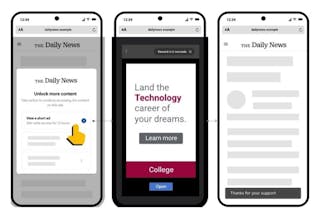

目前使用者可以透過各種方式使用Google Search服務,同時Google也持續擴展旗下人工智慧技術,並且與更多資料串接,例如在對抗假新聞的過程中,便與諸多新聞業者合作內容,透過事實查核機制提供正確新聞報導內容,並且透過近期推出的Journalist Studio,讓新聞記者更有效率完成工作,另外也能透過Pinpoint工具讓記者能上傳參考文件、圖像、筆記內容及錄音資料,藉由機器學習、分類方式讓此類資料能被活用,進而讓記者撰寫新聞內容可更貼近事實。

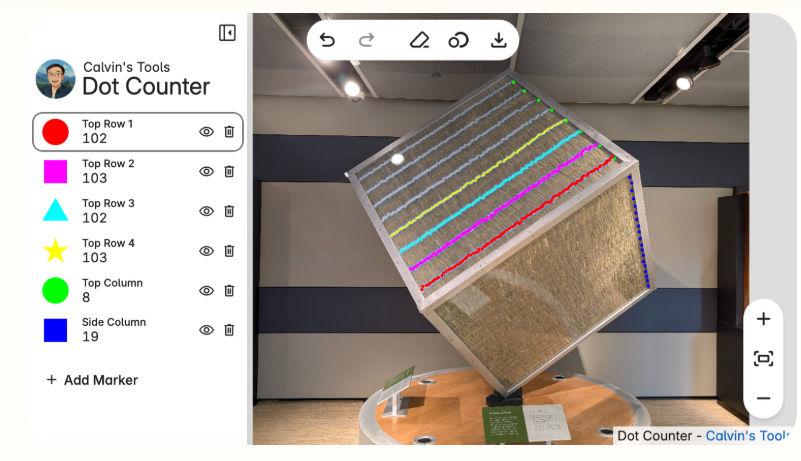

另外,擴增實境更是Google持續深入發展項目,不僅將會成為未來全新互動模式,同時也將帶來全新人機互動體驗,對於搜尋使用需求也能產生全新應用,例如讓使用者能透過擴增實境方式了解個人搜尋物件,或是透過Live View方式讓使用者能透過手機了解周圍環境。

依照Google說明,搜尋是本身最初發展項目,同時也是使用者最直覺查找資料的方式,如何讓使用者更容易找到當下所需解答,更成為Google持續前進目標。

哼唱搜尋內容

在此次線上活動的最後,Google更透露未來將加入讓使用者透過哼唱方式 (Hum to Search),即可搜尋對應歌曲等內容的功能,或許未來也會協助使用者查找各類一閃而過的想法。