本文章引用自 Serafim

一、40G/100G的應用,由長途電信網路走向資料中心

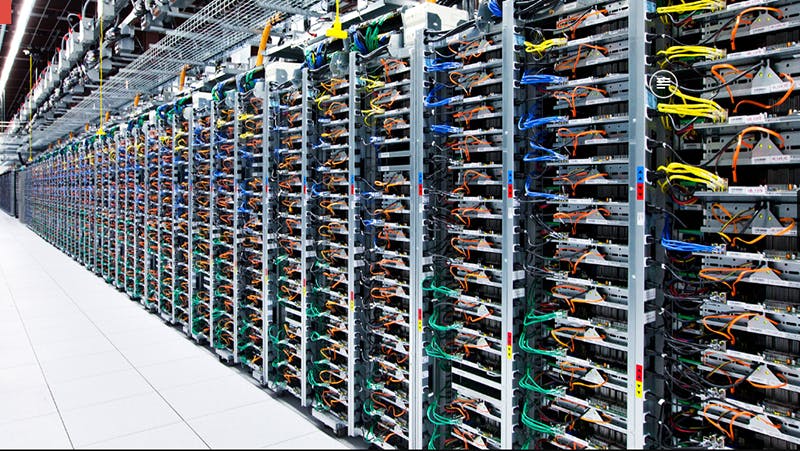

雲端計算與雲端存儲將大量的計算與存儲設備集中在一起,通過高速網路將這些設備連接起來。各家伺服器廠商各有獨到的技術,將大量伺服器與存儲空間虛擬化調度,使得運算資源與存儲空間可以靈活地運用並相互備援,這中間的聯絡使用到更多的伺服器之間的通訊,速度要求也更高。換個角度說,一個使用者從網路瀏覽或雲端下載1G的資料,已不是由單一伺服器傳輸1G 的資料量給用戶,而是在資料中心內部高達10G以上的資料傳輸流量及運算而來。

於是,這些以往只是小規模存在長途電信網路的40G/100G元件,逐漸走向資料中心等數據通訊的大規模應用。

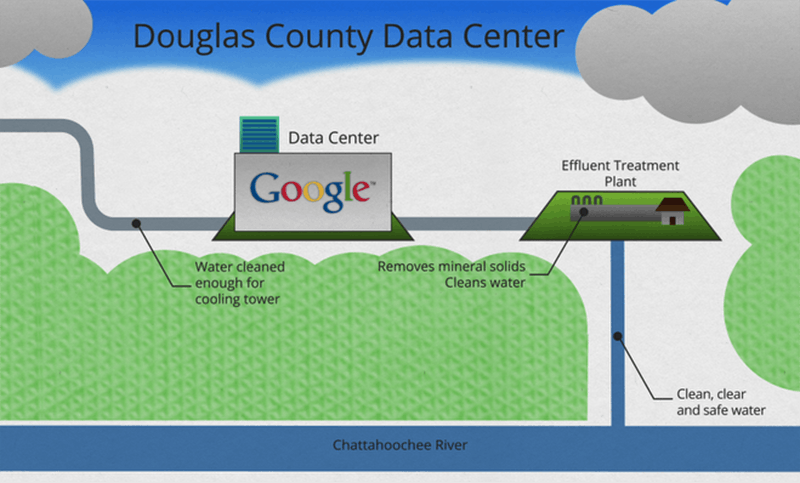

(圖一: Google Data Center 的伺服器密度)

二、資料中心之介面與元件性能尚無實體標準

在電信與網路的應用,過去通常是由IEEE、ITU等機構訂出統一的通訊協定標準,包括發送端與接收端的各項性能規格,其目的是在於系統的相容性、互通性,並保留足夠的規格餘量(spec margin)來保障電信通訊的品質。因為電信公司的設備分布在全國各處,如果某個機房或基地台的一個元件故障,要派人過去維修是相當麻煩。而且客訴電話會接不完:)

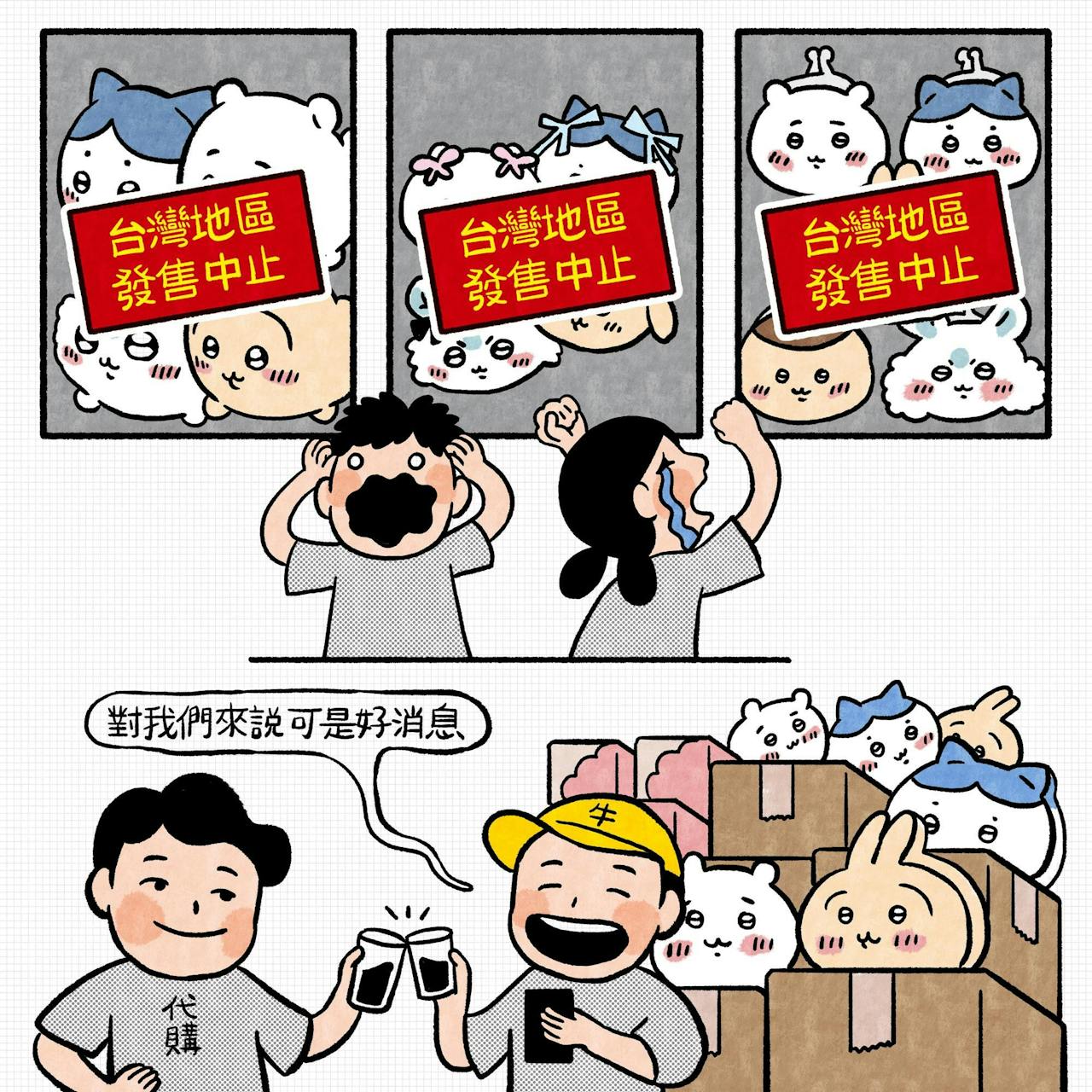

然而,資料中心的伺服器集中管理,維護相對方便,這概念有點接近於家用的產品,當你添購Wifi 路由器時,一般人在意的是價格與低耗電,可靠性與壽命可能會擺在第二位。你不會願意花三倍的價錢去買一個二十年不會壞的路由器,原因很簡單,過幾年壞了,大不了就再換一個新的,順便換一個速度更快的。

於是,資料中心在意的可能更會是成本、尺寸、功耗,因為其系統通常都是封閉且客製化的,不太需要考慮與別家系統的兼容性,系統的更新與汰換頻率也遠高於傳統的電信商。功耗問題亦是資料中心最重要的考量之一,重要性不亞於性能與可靠性。因為電費支出是未來資料中心的重要營運成本,密集且高耗能的系統也會帶來散熱問題與電源建置成本。

(圖三: 位於Oregon 的Data Center,鄰近河邊可以就近取水散熱)

三、傳輸距離與技術瓶頸,40Gbps/100Gbps多採用多通道(multi-channel)方式來實現

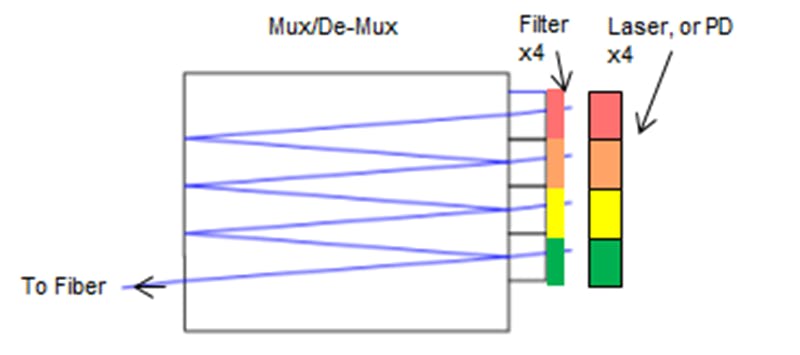

若使用單一元件要達成40Gbps或100Gbps,在雷射(laser)製造技術上是相當困難且昂貴的,即便許多先進的研究已經可以用單一雷射(laser)達成如此高速的傳輸,但傳輸距離不長,且其配套的驅動IC、放大器… 等元件也會是問題,更別提一般平價電路板上的RF損耗。於是,將40G/100G商用化的最佳捷徑便是利用現有的10Gbps/25Gbps光學元件,採用多通道來實現,亦即4x10Gbps、10x10Gbps, 或是4x25Gbps. 如此電路板與其他高速元件只要處理10Gbps 或是25Gbps的頻寬,整體成本會便宜的多。

Data Center 動輒數百米大,其所需要的傳輸距離也要幾百米甚至到1km,這麼長的光纖cable成本也不低,於是500m 以上的應用,幾乎都是先在模組端集成單一光纖再做傳輸。作法是在模組端加入分波多工(WDM)的Mux/Demux光學元件,讓四路光訊號先集成一路,進入一條光纖後,在接收端在用相同的方法分出四路訊號來。

然而,多通道的生產良率相當於多顆模組良率的相乘,良率是一大挑戰,亦是決勝關鍵。

四、功耗的挑戰,將仰賴更高效率的雷射(laser),以及更聰明的控制電路來解決

以一般單模光纖使用的雷射(laser)來說,四個通道4x10Gbps約需要消耗功率2.5W~3W, 4x25Gbps需要EML加TEC控溫則需要功耗5W以上。未來需要開發更高效率、低臨界電流(Ith)的laser 光源,以及更低功耗的laser驅動電路來降低功耗,必要時甚至得犧牲一些性能。光模組也許需要更先進的調整電源管理技術,對模組關鍵功耗晶片的工作狀態進行動態調節,有效降低處於待機狀態模組的功耗。

你或許會喜歡