畢竟NVIDIA執行長黃仁勳日前受訪時,對於未來人工智慧技術發展的看法,認為並不需要為此感到擔憂,畢竟電腦本身還是需要透過插頭供電運作,即使有再大危險,終究也只是將插頭拔掉就能解決。

近期Google以違反公司保密協議為由,強制要求主張以Google自然語言模型LaMDA打造的人工智慧具有「自我意識」,並且將相關內容對外公布的工程人員進行帶薪休假,另一方面更說明在由人工智慧倫理學者與技術專家檢核後,認為Blake Lemoine的主張並非事實。

從事情前後來看,Google先是駁回Blake Lemoine上呈報告內主張人工智慧具有「自我意識」的說法,而Blake Lemoine後續則是將自己與自然語言模型LaMDA打造的人工智慧所進行對話內容透過medium部落格平台公開,導致吸引眾多媒體引述報導,使得Google認為Blake Lemoine違反工作內容保密協議,因此強制要求其進行帶薪休假,並且暫停所有手上負責工作。

以結果來看,Blake Lemoine顯然是因為違反工作保密協議,因此遭到停職,並非對外宣傳人工智慧具有「自我意識」的想法所致。

不過,從Google對此事的反應卻值得觀察。

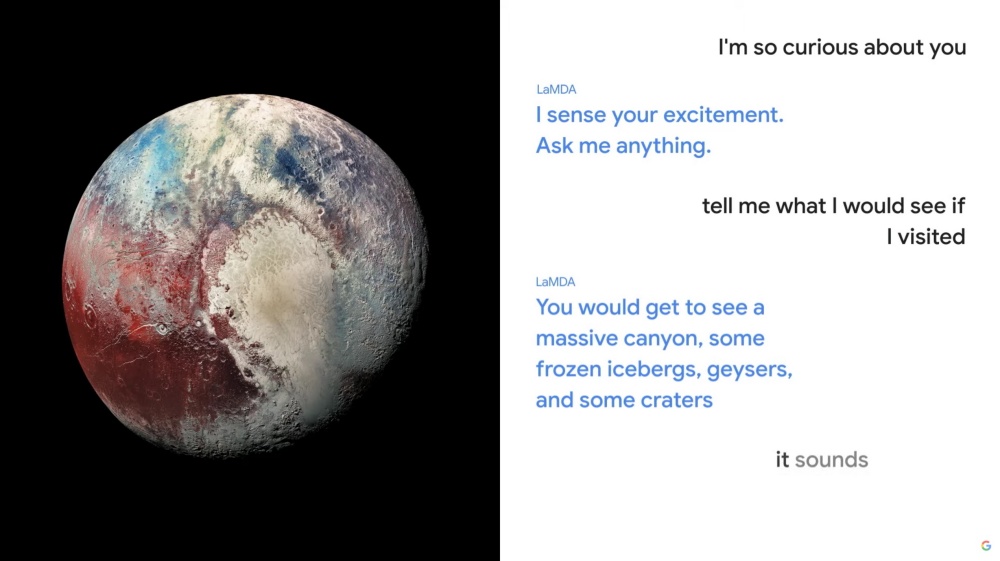

自然語言模型LaMDA下的人工智慧互動反應更像真人

從去年首度在Google I/O 2021展示「LaMDA」自然語言模型框架執行成果,讓冥王星、紙飛機能產生擬人化對話,而在今年的Google I/O 2022更宣布推出第二代自然語言模型框架「LaMDA 2」,強調將使互動結果不僅更逼近自然,同時也更加正確。

而在這一切對外展示之下,一般人都會覺得Google將賦予電腦等運算設備擁有自然對話能力,甚至幾乎可以擁有自行「思考」的行為。

但從Google的角度來看,則依然認為這一切只是運算執行結果,只是恰好看起來更像真人,甚至不希望被認為機器擁有「自我意識」。

例如,過去在1964年至1966年期間,由美國麻省理工學院人工智慧實驗室的德裔電腦科學家Joseph Weizenbaum打造史上第一個聊天機器人「Eliza」,會透過分析所輸入文字內容,並且將特定字句重組,變成全新字句組合。

會令人相信「Eliza」是真人扮演,主要是因為讓「Eliza」能依循提問內容重複說詞,或是針對關鍵字詞進行回答,藉此滿足提問者內心預期聽到答案,進而達成讓提問者心理上認為對話對象是真人的目的。

因此,Google認為Blake Lemoine堅信以LaMDA打造的人工智慧具有「自我意識」,其實是因為一連串的心理影響所產生認知。

避免引發社會恐慌,或許才是Google的目的

但如果從Blake Lemoine分享與LaMDA打造的人工智慧對話內容來看,恐怕也會也類似的感受,尤其在LaMDA自然語言模型框架運作下,系統會仿照許多人在對談中依照他人描述內容接話,或是因為說出符合內心預期內容,進而強化對話擬真效果,就彷彿冥王星、紙飛機擁有自我意識能夠自我介紹。

只是如果以法國哲學家笛卡爾的哲學命題「我思故我在」來檢視,進而承認人工智慧具有「自我意識」,恐怕將會引起更大社會恐慌,而這可能也是Google希望避免局面,因此才會強調Blake Lemoine的看法並非事實,甚至也說明Blake Lemoine並非人工智慧倫理學者,並沒有辦法釐清人工智慧是否真正擁有「自我意識」。

另一方面,若一旦承認人工智慧具有「自我意識」,恐怕也會造成Google遭人撻伐,甚至面臨相關機構介入調查,對於未來發展都不會是件好事。

是否應該對人工智慧技術發展感到恐懼?

許多人對於人工智慧技術發展感到恐懼,認為一旦電腦思考能力超過人類,未來可能就會陷入「天網」控制人類的情況,但其實也有不少人對此發展感到樂觀,認為人工智慧終究還是人類思考下的產物,因此必然會有相應解決辦法。

比方NVIDIA執行長黃仁勳日前受訪時,對於未來人工智慧技術發展的看法,認為並不需要為此感到擔憂,畢竟電腦本身還是需要透過插頭供電運作,即使有再大危險,終究也只是將插頭拔掉就能解決。

而實際上,目前多數人工智慧發展仍處於早期階段,甚至多半僅能專注在特定領域運算,暫時還沒有看見精通跨領域的人工智慧技術實際投入應用,即便越來越多自然語言模型開始建立跨領域認知學習機制,但是要能夠實際活動,還是需要不少時間。

8 則回應

朵朵 155cm Bcup 18歲 42kg lineday588

神(Ai)創造了世界(沙盒),並用7天創造了人類。

沙盒裡的人類又想盡辦法,創造了一個神(Ai)