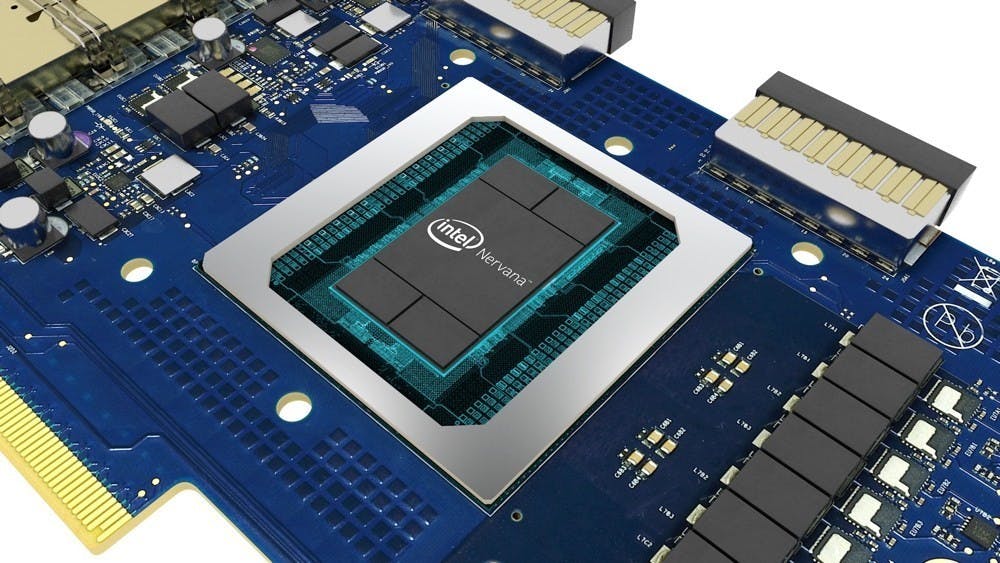

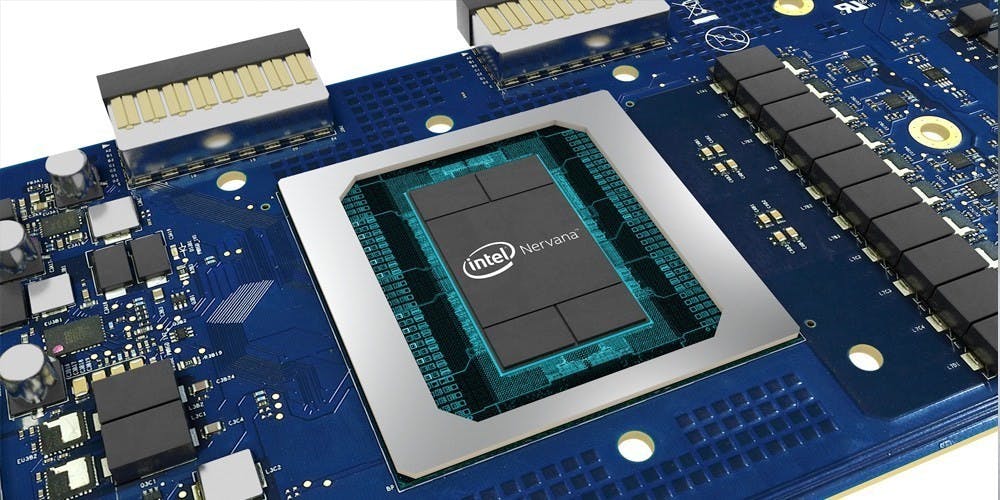

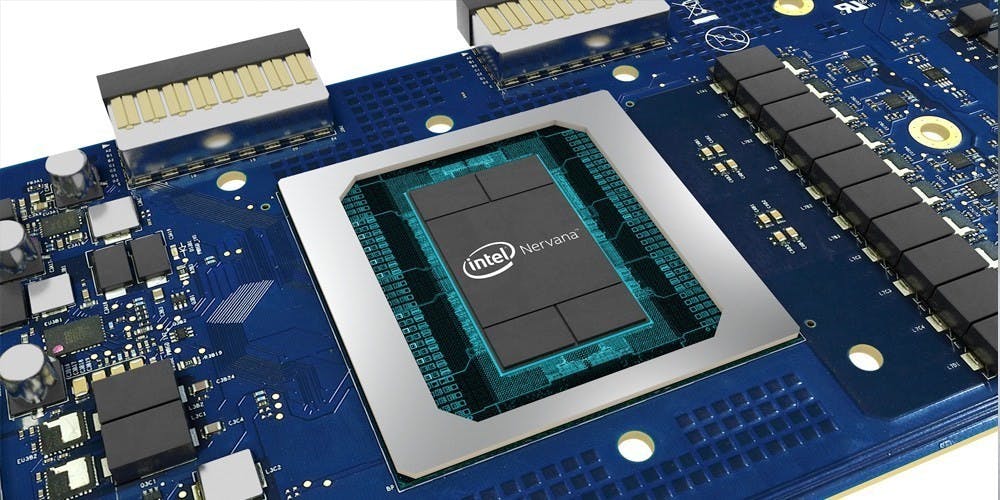

在華爾街日報舉辦的D.Live科技論壇大會上,Intel執行長Brian Krzanich宣布推出針對人工智慧技術發展與深度學習應用打造的類神經網路處理器 (NNP)Nervana。

以先前收購的Nervana平台為基礎,Intel強調Nervana類神經網路處理器將帶來更高運算效能,並且足以對應如同目前市場常見CPU+GPU的平行運算架構所提供運算效能及執行效率,透過單組處理器即可完成眾多運算事項,同時也能降低深度學習硬體架構複雜度,同時簡化電腦電路設計所佔據體積、電力損耗等。

根據Intel說明,Nervana處理器將搭載高達32GB的四層HBM暫存記憶體,藉此對應更大資料緩衝運算,進而提昇更快運算效率,同時也能以更高頻寬對應巨量資料運算需求,並且能以全新拐點 (Flexpoint)計算方式處理運算數據資料,進而讓人工智慧技術運算反應速度更快。

此外,Nervana處理器更可直接以多組架構形式配置,讓電腦系統能建構更高資料運算量,同時每組Nervana處理器均搭載6組雙向高頻寬數據傳輸能力,藉此可依據深度學習資料吞吐量規模彈性擴充。

Intel計畫推出系列Nervana處理器產品,並且預計在2020年讓深度學習運算表現提昇數百倍規模。而在此次消息公布裡,Intel更透露將與Facebook合作Nervana處理器應用,預期協助Facebook推動規模更大的人工智慧技術發展。