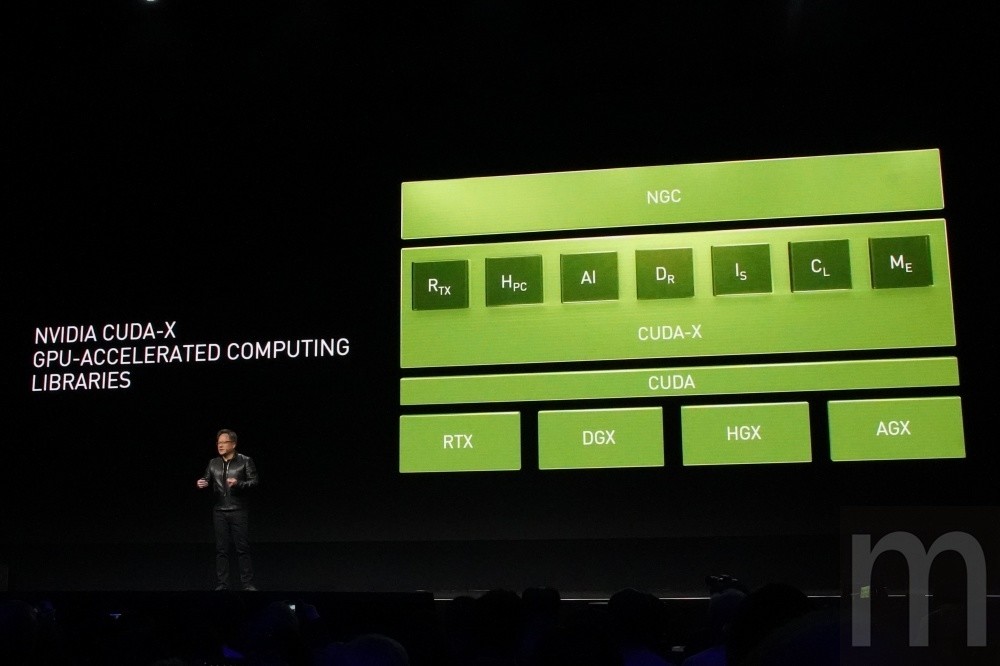

Tesla T4伺服器將搭配NVIDIA全新CUDA-X AI加速演算平台,透過Turing顯示架構、TensorRT運算框架,且相容Turing Tensor Cores設計,約可帶來50倍以上的加速運算效果。

去年宣布推出對應各類服務終端運算需求與佈署彈性的迷你加速卡Tesla T4之後,NVIDIA在此次GTC 2019宣布將以Tesla T4構成的伺服器,搭配全新CUDA-X AI加速演算平台推動更高資料分析研究,以及人工智慧與深度學習應用發展。

可相容既有伺服器基礎架構設計,同時整體耗電量僅需70W即可驅動運作的Tesla T4構成伺服器,搭配NVIDIA全新CUDA-X AI加速演算平台,透過Turing顯示架構、TensorRT運算框架,並且可相容Turing Tensor Cores設計,進而推動各類人工智慧運算模型,NVIDIA強調約可帶來50倍以上的加速運算效果,並且帶來更大的人工智慧運算應用成長推力。

目前包含美國通訊公司Charter、微軟、PayPal、SAS與Walmart均導入CUDA-X AI加速演算平台,並且可佈署於桌機、工作站、伺服器或雲端運算平台,透過各類形式加快運算效率,而硬體伺服器設計應用方面,NVIDIA目前也與Cisco、Dell EMC、富士通、Hewlett Packard Enterprise (HPE)、Inspur、聯想與中科曙光 (Sugon)在內伺服器廠商合作。

此外,NVIDIA也將與Dell、HP、聯想、CAMX、BOXX在內廠商合作,預計推出搭載兩張搭載96GB顯示記憶體設計的Quadro 8000繪圖卡,並且預裝CUDA-X AI加速演算平台,並且㨃ˋ硬RAPIDS、TensorFlow、PyTorch、Caffe在內人工智慧學習演算框架,藉此發揮10倍以上運算效率的工作站機種,主要對應數據分析應用。

而目前包含微軟Azure、亞馬遜旗下AWS在內雲端平台服務也均採用CUDA-X AI加速演算平台,同時AWS更計畫在接下來幾週內將Tesla T4導入旗下Amazon Elastic Compute Cloud (EC2) G4伺服器內。