GTC 2024:群聯攜手技嘉、華碩、MAINGEAR、台灣大哥大、聯發科建立aiDAPTIV+技術合作夥伴,提供地端客製化AI訓練、將SSD化為DRAM增加模型可訓練規模

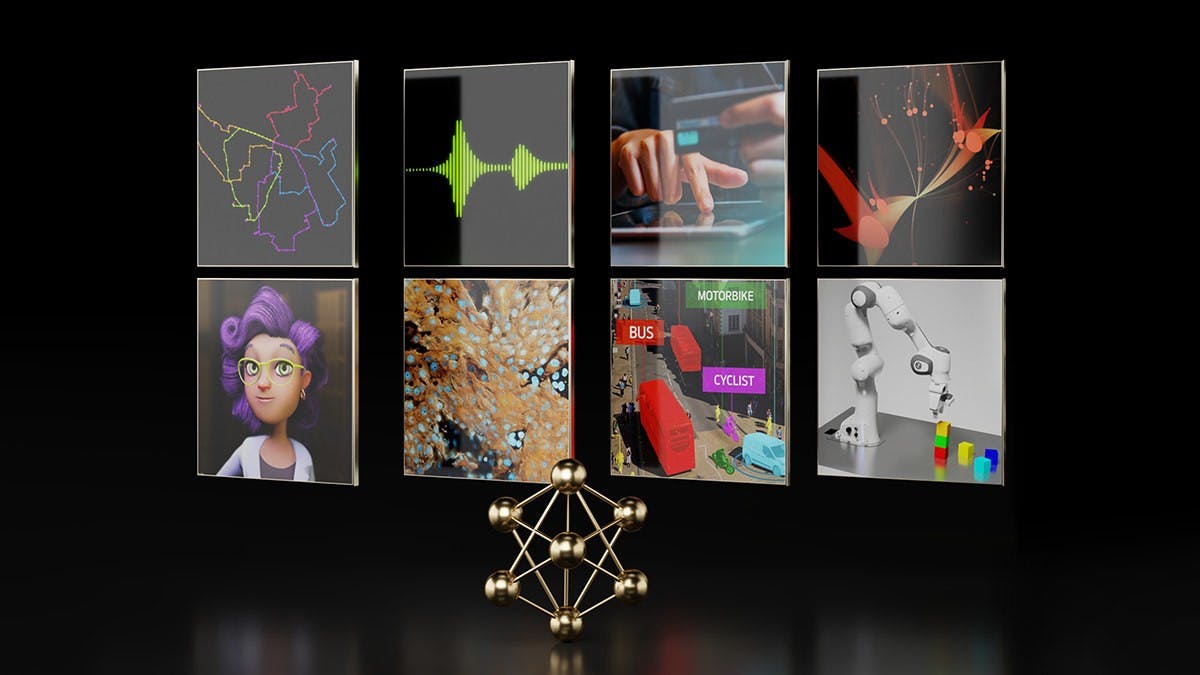

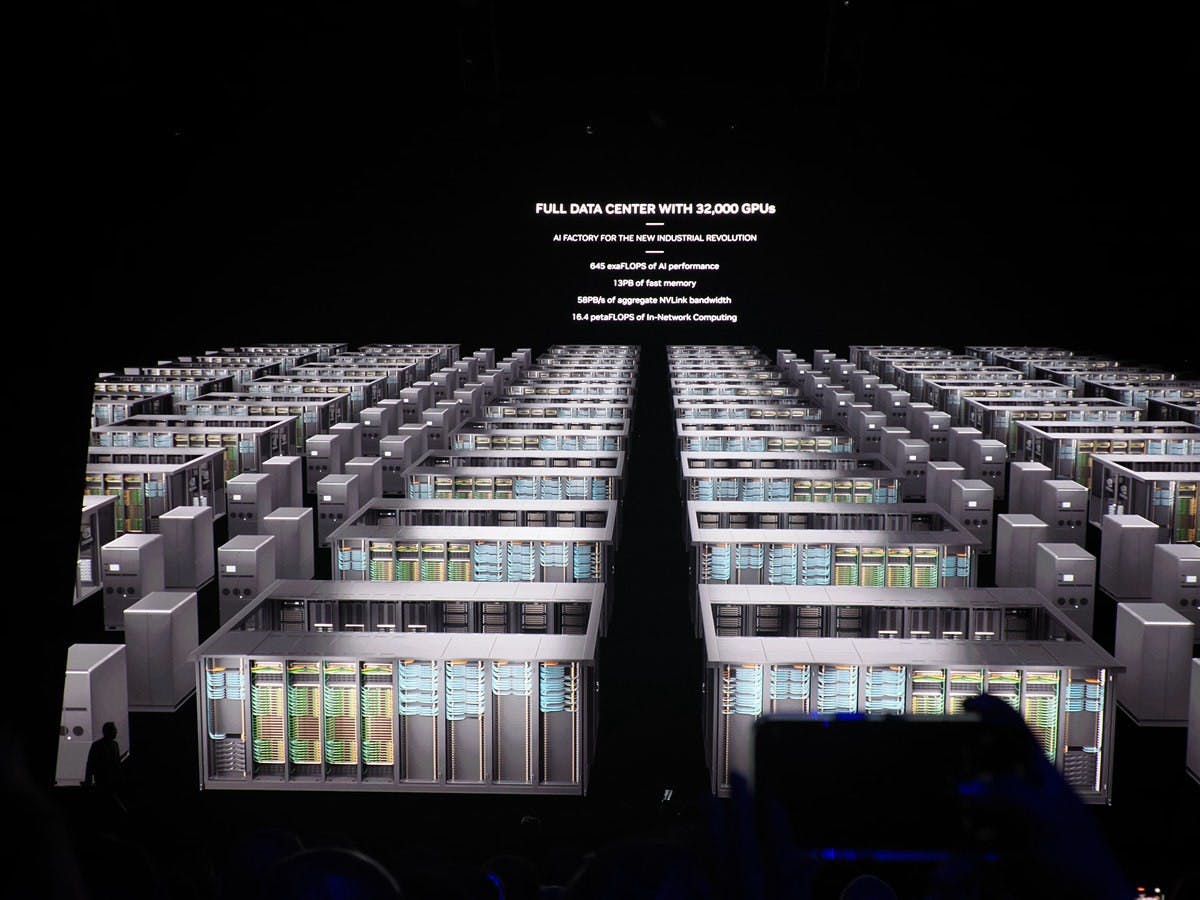

群聯電子PHISON於NVIDIA GTC 2024大會宣布與技嘉、華碩、MAINGEAR、台灣大哥大、聯發科攜手建立aiDAPTIV+技術合作夥伴關係,aiDAPTIV+是整合硬體與軟體的AI模型微調訓練解決方案,並透過群聯於高速儲存的專精,透過低成本的SSD結合AI加速器擴增DRAM容量,使企業可在不大幅增加成本提升可訓練模型的規模,企業在進行AI模型微調的過程又可保有資料安全與不外流,確保企業客製化AI模型的安全性。 當前AI預訓練是客製化AI模型的重要基礎,而aiDAPTIV+則是在預訓練的模型為基礎化為可理解特定領域的專業工具,諸如法律、會計、醫療、工程等,提供該領域的精確服務。透過

1 年前