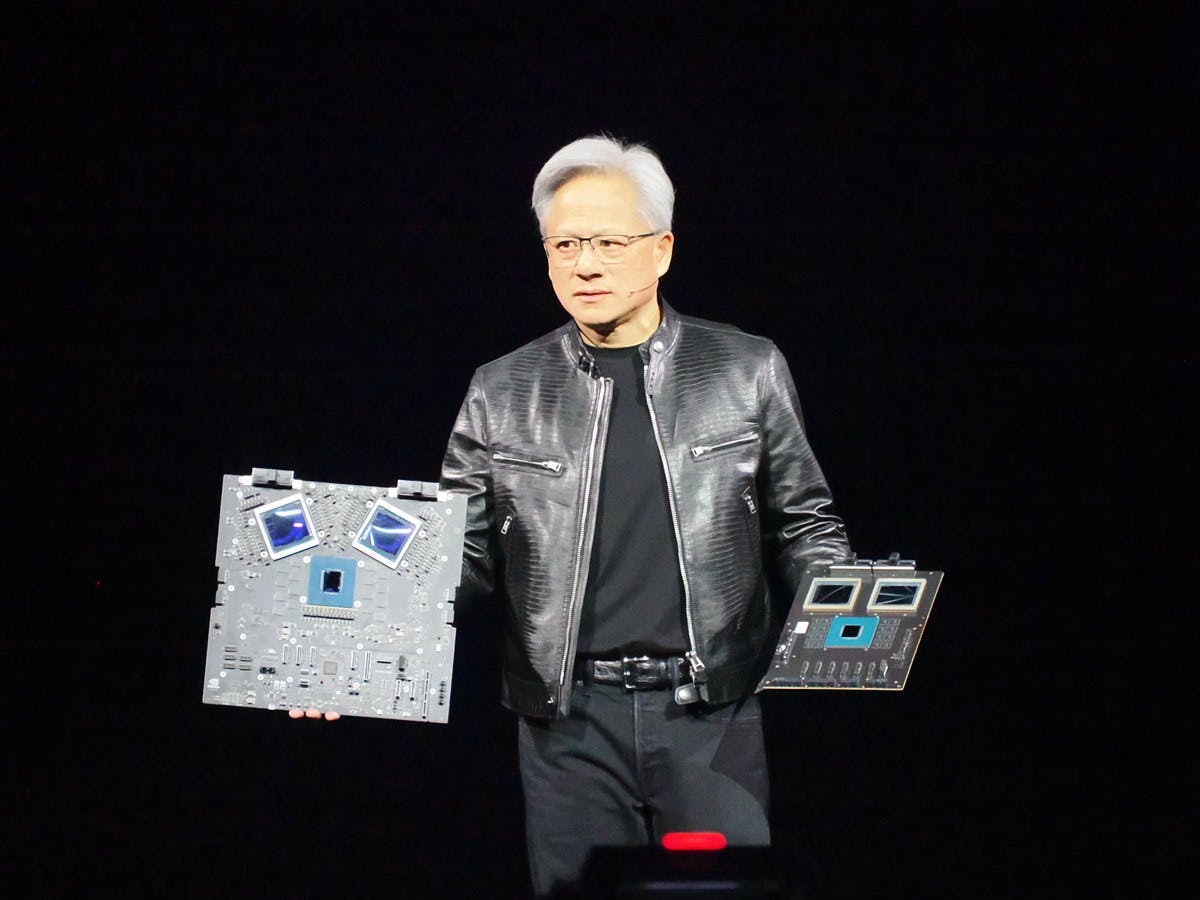

GTC 2025:華碩展出搭載NVIDIA GB300 NVL72的AUS AI POD,預告也將推出基於NVIDIA GB10的'ASUS Ascent GX10小型AI超級電腦

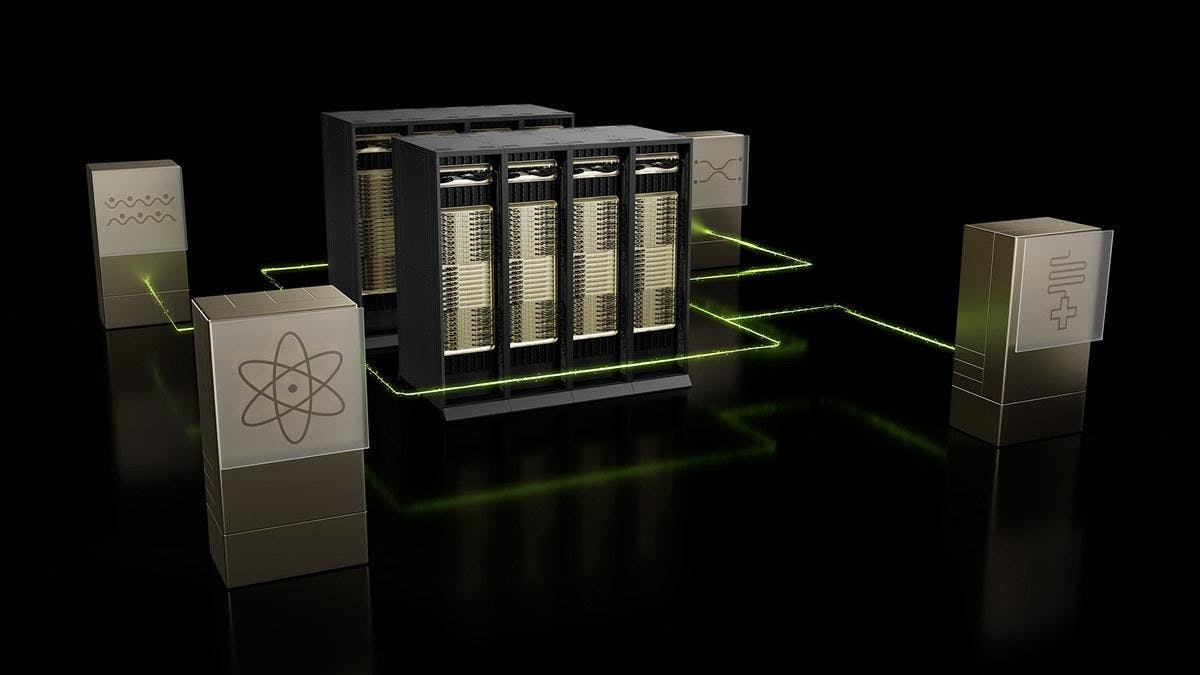

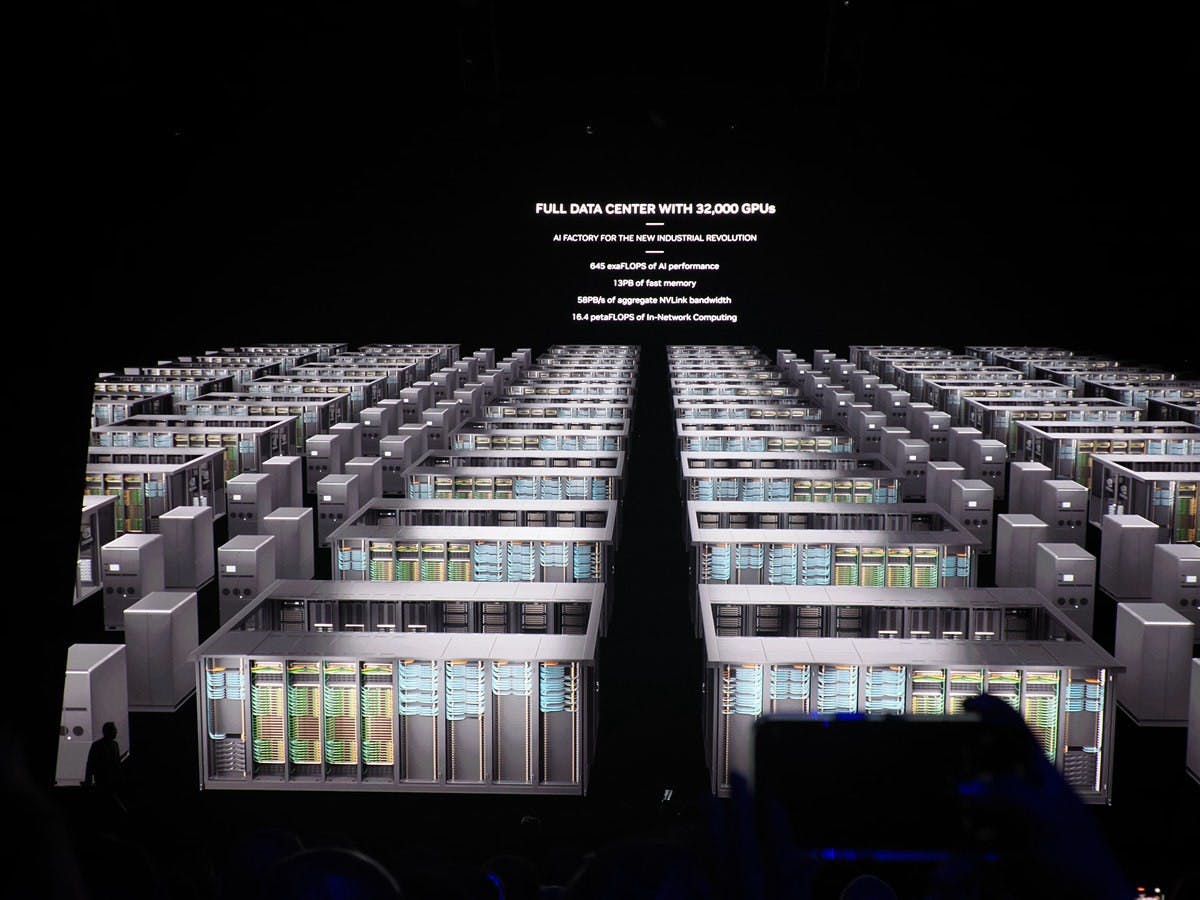

華碩在GTC 2025展出基於NVIDIA GB300 NVL72的ASUS AI POD,以華碩自NVIDIA GB200 NVL72架構資料中心的建置經驗為基礎,採用機架規模設計,具備36個Grace CPU與72個Blackwell Ultra GPU,每機架記憶體達40TB,同時整合NVIDIA Quantum-X800 InfiniBand和Spectrum- X Ethernet網路平台,搭載易於維護的SXM7與SOCAMM模組、採用100%液冷設計,可支援兆級參數的LLM推論與訓練;另外華碩也宣布將攜手NVIDIA的DGX Spark計畫,推出搭載GB10晶片的ASUS Asce

4 個月前