NVIDIA 技術長指稱加密幣對社會一點用都沒有,還不如把運算資源拿去做聊天機器人

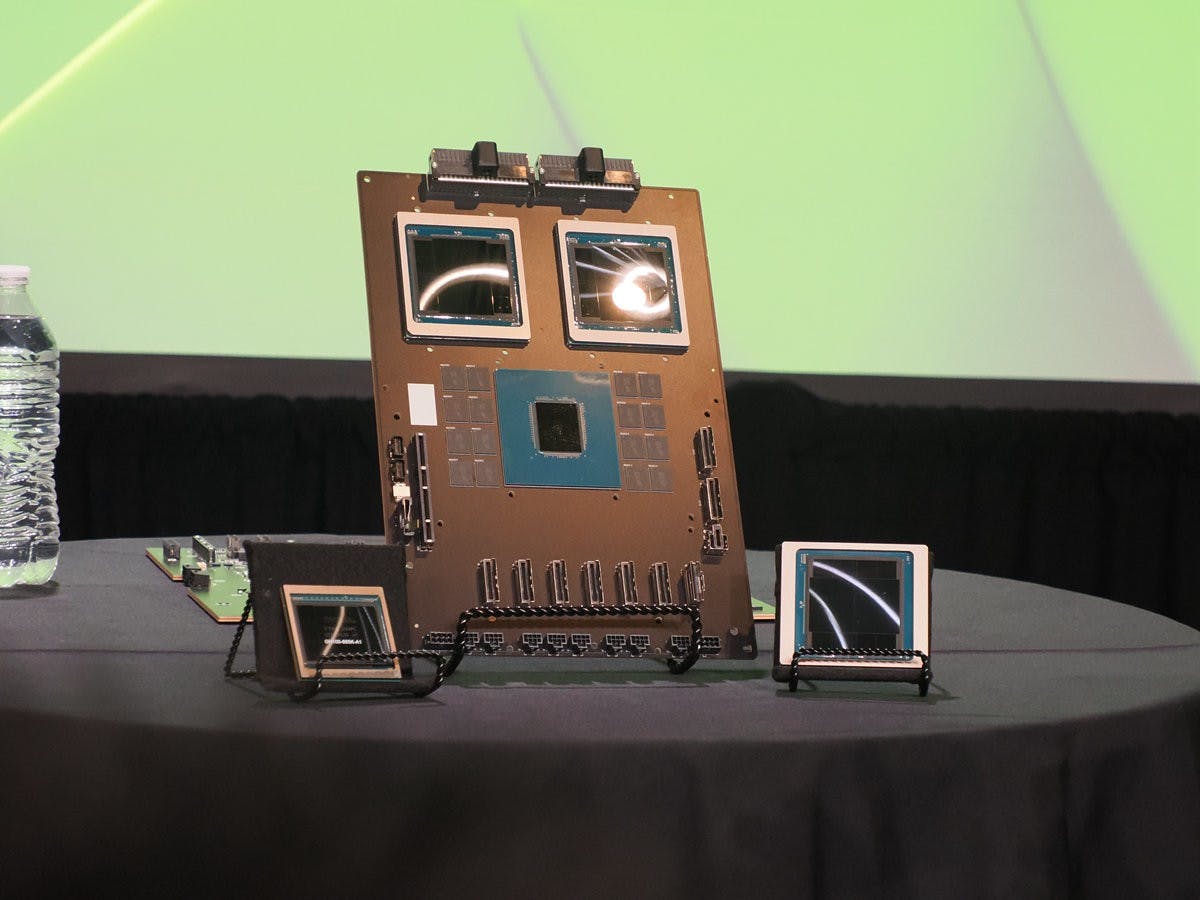

雖然 NVIDIA 靠著幾年前的加密貨幣狠狠賺了一大筆,不過加密貨幣對於 NVIDIA 可能是個矛盾的產業;根據 NVIDIA 技術長 Michael Kagan 接受衛報採訪時指稱,加密幣對於人類社會並沒有創造任何價值,不如將這些算力用於發展 ChatGPT 一類的聊天機器人;附帶一提的是, Michael Kagan 是 Mellanox 的創辦人與技術長,在 Mellanox 被 NVIDIA 收購後, 2020 年開始擔任 NVIDIA 的技術長。 ▲ Michael Kagan 是原 Mellanox 聯合創辦人暨技術長,在公司被 NVIDIA 收購後於 2020 年擔任 NVIDI

2 年前