Intel 執行長稱將收復 AMD 在個人電腦與伺服器的處理器失土,但分析師認為很拚

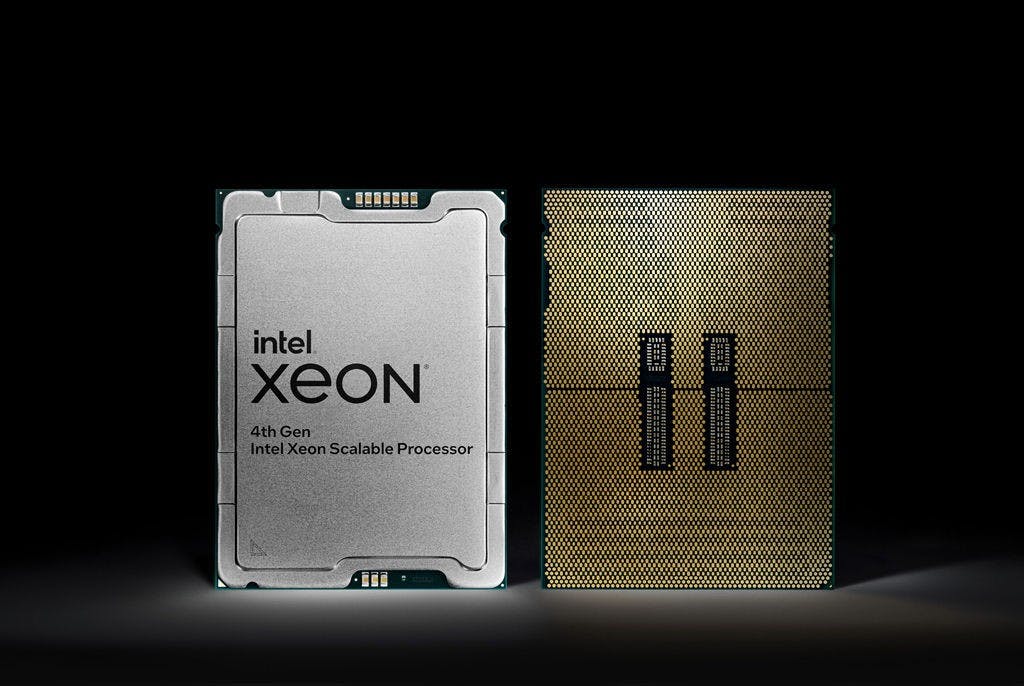

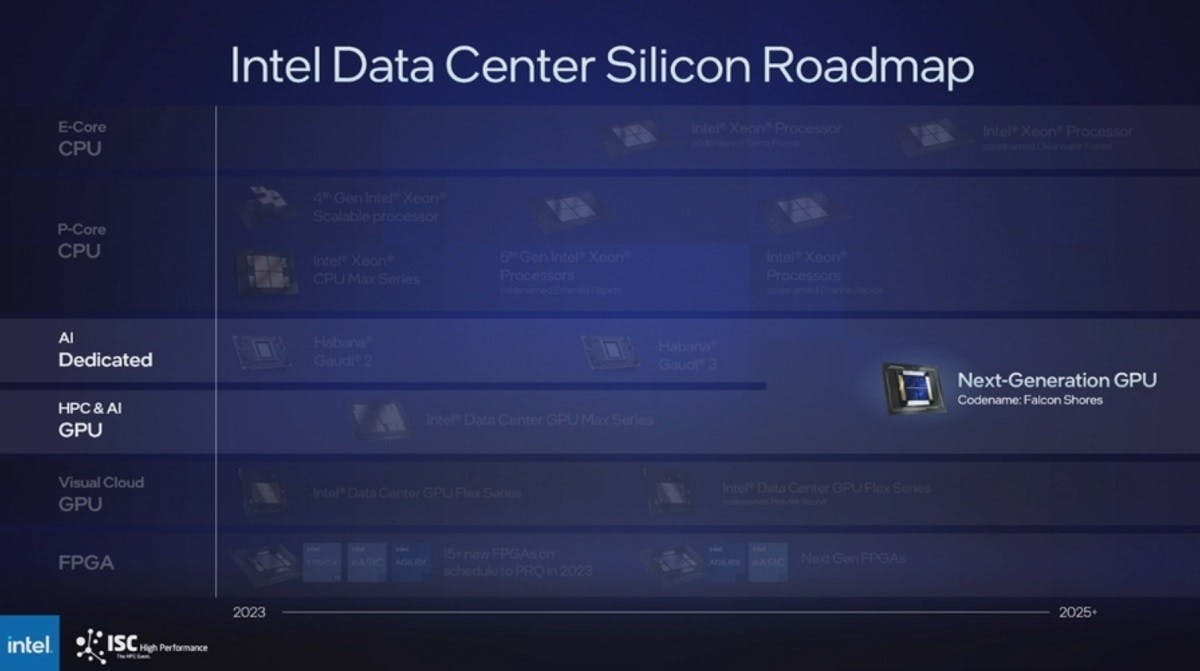

Intel 近期雖然在 Pat Gelsinger 接任執行長後進行大刀闊斧的改革,不過畢竟包括祖產半導體製程以、架構設計與先前瘋狂併購後的資源重整等問題積習已深, Intel 目前的狀況仍稱不上滿血復活,尤其 Intel 新一季財報低於華爾街預期約 30 億美金,更顯得 AMD 當初在 Lisa Su 領導下趁 Intel 委靡不振時搶下包括消費級個人電腦與資料中心及伺服器的處理器市場;然而 Pat Gelsinger 聲稱 Intel 已經度過最糟糕的改革期,認為 2023 年會回歸軌道並奪回失去的市占,只是許多產業分析師並不看好 Pat Gelsinger 的說法。 根據路透社報導指稱,

2 年前